Memória, agentes e o Second Brain

O Karpathy publicou um gist sobre LLM Knowledge Bases. Tenho tentado organizar minhas próprias informações, podcasts, anotações e reflexões em um wiki parecido. A ideia central: em vez de o LLM gerar respostas toda vez a partir de documentos brutos (como faz o RAG), ele constrói e mantém uma wiki persistente. Cada nova fonte é integrada, cross-linkada, sintetizada. O conhecimento é compilado uma vez e mantido atualizado. Como ele coloca:

Humans abandon wikis because the maintenance burden grows faster than the value. LLMs don’t get bored.

Eu gravo pensamentos por voz e o LLM organiza em nodes de conhecimento. O conteúdo é meu. A manutenção é da máquina. Karpathy de novo:

The human’s job is to curate sources, direct the analysis, ask good questions, and think about what it all means. The LLM’s job is everything else.

Só que a maioria dos projetos de “Second Brain” vai na direção oposta: mais ingestão, mais fontes, mais dados. Soluções como OpenClaw prometem bots que fazem tudo e integram diferentes frentes de trabalho. Objetivo? Ser humano 10.000x. Esse ingest de informação acaba sendo absurdamente maior. Como disse um amigo meu, sênior em uma das big techs de AI lá fora:

tá um saco, todo dia tem 5 anúncios revolucionários de alguém que fez um Second Brain. Quando eu preciso organizar meus pensamentos eu vou lá fora e fico olhando pras montanhas tomando um chá. Esse tesão por multiplicar o próprio output ou “se copiar” pra economizar trabalho acabou causando muito mais trabalho pra todo mundo em volta

Precisamos dar passos menores. Organizar o que já escrevemos e falamos, como no zettelkasten. E não tentar capturar a internet inteira através de claws, garras e robôs.

Pessoalmente, estou tentando ingerir apenas os sinais que eu consigo digerir. Não quero pedir pra um bot buscar aleatoriamente um volume monstruoso sobre assunto qualquer. O termo second brain diz bastante: é um segundo cérebro, não 10 mil cérebros. Estamos cansados de tantos estímulos. O excesso de ruído atrapalha até a máquina. Fica muito difícil separar o signal versus noise.

Esse problema da memória está aparecendo em diversos projetos open source. No Hermes Agent, com profiles isolados com MEMORY.md e SOUL.md (memória flat, sem decay). No Mem0, um memory layer para agentes com vários mecanismos de retenção. No Cabinet, que usa markdown no disco com git e agentes com cron. Tem também o Agent Second Brain com Ebbinghaus decay e o PaperClip. Para onde olhar, qual escolher?

O Daniel Miessler desenhou um sistema pessoal sofisticado (talvez demais). Ele chama de Personal AI Infrastructure. E também definiu como Daemon isso que parece estar acontecendo: uma API pessoal que cada pessoa tem. Hoje essas APIs são menorzinhas: nosso site, nosso Twitter, nosso calendar com invite automático, nosso botzinho do Telegram. Vai ser avassalador o crescimento dos nano serviços pessoais. Daniel chega a vislumbrar uma AURA visível com Augmented Reality: uma listagem das APIs que cada pessoa oferece. Um “/menu” do meu bot de Telegram, só que basta me olhar para acioná-lo.

O Pedro Franceschi, da Brex, contou que roda a empresa via OpenClaw. O sistema dele começa com um signal ingestion pipeline que filtra email, Slack, Google Docs, WhatsApp. A sacada: as ferramentas de produtividade com IA falham porque não assumem que o mundo é barulhento. Milhares de canais no Slack, centenas de emails por dia. O que importa? No que prestar atenção?

O Stephen Wolfram coleta dados pessoais da própria vida há décadas. Tudo vira dado. Com LLMs, a utilidade só cresce. Mas fica a questão de privacidade.

Chegou a hora de usar a inteligência artificial para guardar, anotar e ver aquilo que de fato selecionamos, e para tirar o ruído disso. Não para aumentar a quantidade de conteúdo a consumir. Precisamos diminuir a boca do funil, não aumentá-lo.

O que estou tentando construir tem 3 camadas:

Observe: ver o que os agentes estão fazendo, navegar nos signals e vaults. O Karpathy usa Obsidian como frontend da wiki. Eu uso um dashboard que mostra as vaults, o grafo de conexões, e notas publicáveis que saem direto de áudios.

Operate: agir cross-vault. Mover signals, reclassificar, mergear drafts, rodar pipelines.

Orchestrate: um meta-agente com contexto de todos os vaults, que sabe orquestrar os outros. É o Advocate do Miessler, o Q&A Agent do Karpathy que “compounds” conhecimento a cada pergunta.

No meu caso, gravo um áudio no Telegram, o Whisper transcreve, o Opus classifica, o Sonnet sintetiza num node de conhecimento, e o resultado aparece no grafo de signals. Se gosto, promovo pra note e publico. O pipeline inteiro roda em 15 segundos. Mais: ele cross linka com artigos e podcasts que já gravei. Dá pra refletir em cima do que já existe. Sem inventar.

Hoje eu faço as 3 camadas sentado no Claude Code, orquestrando 3 repos. Funciona, mas o contexto se perde a cada sessão. O que quero é que isso vire algo persistente. Cada interação vira um signal, inclusive o JSONL que o Claude Code guarda das sessões.

É um conceito, uma ideia. Não um PRD. Acredito que cada pessoa terá um mecanismo de vault bem particular. Não uma UX unificada. Não um formato estruturado único em uma catedral, e sim um bazar de Markdown, YAML e JSONL e afins. Ninguém vai baixar um open source que resolve. Cada pessoa vai fabricar algo parecido com um tecido retalhado, uma mistura de código estático e prompt, onde um retroalimenta o outro. É um disposable software mutante. O sistema evolui com a forma que você pensa e trabalha.

E esse sistema vai ser importante para você organizar os seus próprios pensamentos. Não os de 10 mil outras pessoas e feeds infinitos. Foque no seu próprio conteúdo, nos seus pensamentos. Trabalhe com eles.

14 comentários

Participe da discussão no X e LinkedIn

Como organizou o file system do projeto?

2 curtidas@MellobPedro aqui a resposta do robo. mas desde que voce mantenha uma vault de raw fieis, o "resto" pode ser reprocessado sempre e indexado sempre: Todas as vaults seguem o mesmo padrão: são repos Git no GitHub com arquivos Markdown + frontmatter YAML como unidade atômica. Cada vault tem

Real, mas tem um detalhe: quanto mais disperso o sinal, mais lixo entra no sistema. Vi muito PKM virar cemitério de markdown. O filtro humano (edit, contexto, intencionalidade) segue sendo o gargalo. Automação sem curadoria = ruído amplificado.

3 curtidas@ContextoIA EXCELENTE ponto. a gente ta tentando fazer ingest da MAIOR quantidade de informacao possivel. Tem de ser o oposto. Tem de ser um Second Brain. 2x o que a gente aguenta. Não 1000x como querem prometer

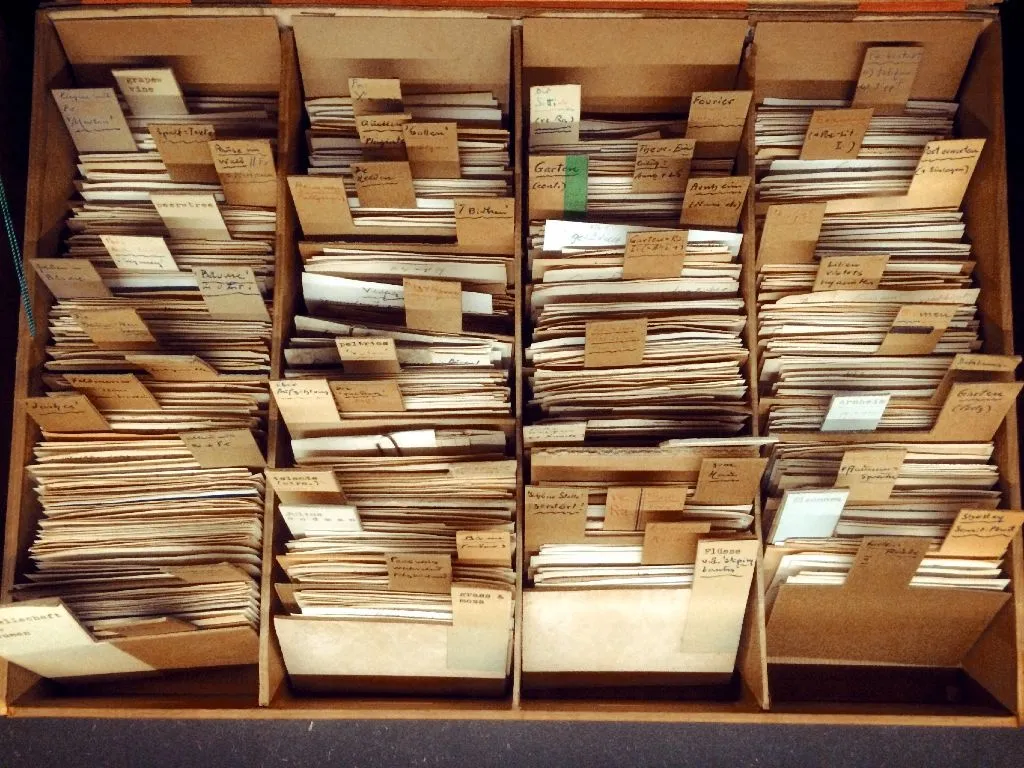

Só sei duma coisa: quanto mais você organiza sua vida e seus documentos, mais bonito isso fica: https://t.co/ek3Z9rdX1g

6 curtidas@sseraphini Muito bom!! É contra intuitivo, mas excesso de informação mais atrapalha do que ajuda… Btw gostei muito da ideia de salvar e organizar notas usando áudio gravado como INPUT! Verbalizar os seus próprios pensamentos e guarda-los (e de fato refletir e consultar eles dps) acaba

5 curtidasConcordo com 90%. O ponto "diminuir a boca do funil, não aumentá-lo" é a melhor coisa que eu li nessa onda toda de Second Brain. Passei 8 meses construindo exatamente isso, um sistema que guarda, anota e conecta aquilo que VOCÊ selecionou. Não um aspirador de conteúdo infinito.

É ISSSSOOO!! Conseguiram traduzir meu sentimento em palavras hahhaha

1 curtidaSim! To adaptando o esquema do karpathy e criando 3 wikis (software engineering, pessoal e filosofia). 1 Vault pai + 3 vaults filhos, com conceitos que se referenciam. Acho que fica mais organizado haha

1 curtidaque doideira que eu acabei de ler!! fascinante. Cara, pode me explicar melhor os beneficios que voce tem com essa aplicaçao atual no seu dia a dia? Estava montando um "cérebro", mas totalmente longe disso que comentou. Achei muito interessante,vou me aprofundar no tema

Ainda q eu concorde - nao fui eu quem reclamou 😆 - jokes aside - converso com colegas e o sentimento é o mesmo: troca de contexto so aumenta, profundidade esta sob risco e qualidade estamos a ver. Gosto do termo “goodput” para medir progresso real ao invés de throuput que mede mais movimento.

Uma ideia que eu gostei bastante e vai nesse sentido, vi um colega postando aqui na rede, é migrar a ideia de gemeo digital para a educação e gerenciamento do conhecimento tornando a ideia do pkm muito mais dinâmica e próxima de uma Antibiblioteca digital, do que um segundo Cérebro. Bloom, que é mais conhecido pela taxonomia famosa na educação, tambem é criador do Problema dos 2 Sigmas, um estudo que demonstra a Tutoria como a forma mais efetiva de aquisição de conhecimento. Com a evolução da ideia do gemeo digital educacional, o tutor passa a ser mais que uma IA, mas um espelho da própria forma da pessoa de lidar com o mundo e aprender sobre ele.

André Luiz vou buscar mais a respeito

Ver mais 4 comentários

Brilhante! Cada cérebro funciona de uma forma diferente, e é interessante como as pessoas buscam um segundo sem saber como o próprio funciona.

Paulo Silveira https://www.linkedin.com/posts/danielluzzi_arquitetura-da-descoberta-ugcPost-7432885449209114625-j1Gz?utm_source=share&utm_medium=member_android&rcm=ACoAAAeZgAkBjJcxP5_gNJjpkuUQtnlmgSI_wj0 Foi esse post que me abriu a mente pra ideia do gemeo digital na educação. Eu já gostava bastante do Problema do Bloom, achava que um tutor IA teria a possibilidade de resolver esse problema. Mas a idéia do gêmeo digital acho muito mais completa.

Ótima reflexão. Muita gente está usando IA para acumular informação quando o ganho real está em organizar e decidir melhor. Quem reduzir ruído e transformar conhecimento em ação vai extrair mais valor do que quem só aumenta ingestão de dados.

@paulo_caelum estes dias construí segundo cerebro para Product Managers em cima do gist do Karpathy. Focado justamente nisso, reduzir ruído e não na quantidade de artigos na wiki. Gerar inteligência. https://t.co/gRRwNxFwC8

1 curtida@bicodeurubu boa! tente usar bastante por um tempo, vc vai ver que vai ficar precisando readapta-lo o tempo todo

Você também pode gostar

Open Claw, Personal Knowledge e Second Brain

Como construí um PKM pessoal com vibecoding, Telegram, Whisper e LLMs para não perder mais ideias

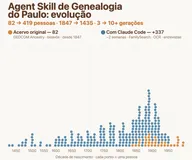

Genealogia, Skills dos Agentes e o Humano no Loop

Como agentes de IA misturam criação e execução de código para pesquisar genealogia, e por que o humano continua essencial no loop.

Vibecoding, Hipsters e Novo Dev

O profissional em T não é novo, mas nunca foi tão necessário. De Werner Vogels na AWS a Bill Gates, passando por Martin Fowler.